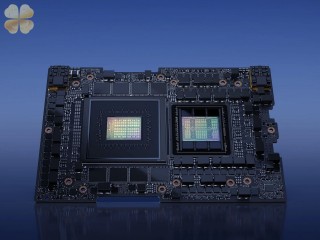

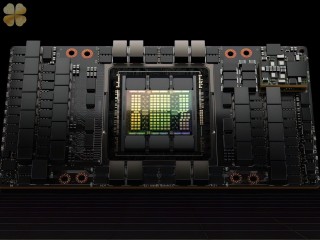

Nvidia TensorRT-LL tăng gấp đôi hiệu suất LLM trên GPU H100

Nvidia cho biết phần mềm mã nguồn mở TensorRT-LL mới của họ có thể tăng hiệu suất đáng kể của các mô hình ngôn ngữ lớn (LLM) trên GPU của họ. Theo công ty, khả năng của TensorRT-LL của Nvidia cho phép họ tăng hiệu suất của GPU H100 của họ lên hai lần trong LLM GPT-J với sáu tỷ tham số. Quan trọng là phần mềm có thể cho phép cải thiện hiệu suất này mà không cần đào tạo lại mô hình.